Comment évaluer la sensibilité de la caméra

Comparer la performance de caméras à l'aide de la norme de performance d'imagerie EMVA1288

Contenu :

- Introduction aux mesures de performances d'imagerie basées sur la norme EMVA1288

- Définition des différentes mesures et comment elles sont mesurées

- Comparer les performances à faible luminosité des caméras à différents temps d'exposition

- Comparaison d'un CCD traditionnel avec un capteur CMOS moderne

- Comparaison des générations de capteurs Sony Pregius

- Conclusion

Il est facile de comparer les spécifications de base des caméras telles que la fréquence d'images, la résolution et l'interface. Utilisez notre nouveau sélecteur de caméra pour filtrer et trier les spécifications EMVA 14+ afin de trouver la correspondance exacte aux exigences de votre projet. La comparaison des performances d'imagerie de caméras telles que l'efficacité quantique, le bruit d’obscurité temporel et la capacité de saturation tend cependant à être un petit peu plus complexe. Nous devons d'abord comprendre ce que signifient réellement ces différentes mesures.

Qu'est-ce que l'efficacité quantique et est-elle mesurée au pic ou à une longueur d'onde spécifique ? En quoi le rapport signal/bruit est-il différent de la plage dynamique ? Ce livre blanc abordera ces questions et expliquera comment comparer et sélectionner des caméras sur la base des données de performance d’imagerie selon la norme EMVA1288.

EMVA1288 est une norme qui définit quels aspects de la performance de la caméra mesurer, comment les mesurer et comment présenter les résultats en suivant une méthode unifiée. La première section du livre blanc aidera à comprendre les différents aspects de la performance d’imagerie d’un capteur d’imagerie. Elle décrira les concepts de base qui sont importants pour comprendre comment un capteur d'image convertit la lumière en une image numérique et définir finalement la performance du capteur. La figure 1 présente un seul pixel et souligne ces concepts.

![]()

Figure 1 : Comment un capteur d'images convertit la lumière en une image numérique

Nous devons tout d’abord comprendre le bruit inhérent à la lumière elle-même. La lumière est constituée de particules discrètes, les photons, générées par une source de lumière. Parce qu'une source de lumière génère des photons à des moments aléatoires, il y aura du bruit dans l'intensité perçue de la lumière. La physique de la lumière indique que le bruit observé selon l'intensité de la lumière est équivalent à la racine carrée du nombre de photons générés par la source de lumière. Ce type de bruit s'appelle le bruit de grenaille.

Il convient de noter que le nombre de photons observés par un pixel dépendra des temps d’exposition et de l’intensité lumineuse. Cet article considérera le nombre de photons comme une combinaison de temps d'exposition et d'intensité lumineuse. De même, la taille des pixels a un effet non linéaire sur la capacité de perception de lumière du capteur car elle doit être mise au carré pour déterminer la zone sensible à la lumière. Ceci sera abordé plus en détail dans le prochain article dans le contexte de la comparaison des performances de deux caméras.

La première étape de la numérisation de la lumière consiste à convertir les photons en électrons. Cet article n'aborde pas la manière dont les capteurs le font, mais présente plutôt la mesure de l'efficacité de la conversion. Le rapport d'électrons générés lors du processus de numérisation des photons est appelé l'efficacité quantique (QE). L'exemple de capteur de la figure 1 présente un QE de 50 % car 3 électrons sont générés lorsque 6 photons « tombent » sur le capteur.

Avant que les électrons soient numérisés, ils sont stockés dans le pixel, appelé le puits. Le nombre d'électrons pouvant être stockés dans le puits est appelé capacité de saturation ou profondeur de puits. Si le puits reçoit plus d'électrons que sa capacité de saturation, aucun électron supplémentaire ne sera stocké.

Une fois la réception de lumière terminée par le pixel, la charge du puits est mesurée et cette mesure est appelée le signal. La mesure du signal de la figure 1 est représentée par une flèche. L'erreur associée à cette mesure est appelée bruit d'obscurité temporel ou bruit de lecture.

Pour finir, l'échelle de gris est déterminée en convertissant la valeur du signal, exprimée en électrons, en une valeur de pixel unités analogiques vers numériques (ADU) de 16 bits. Le rapport entre la valeur du signal analogique et la valeur d'échelle de gris numérique est appelé gain et est mesuré en électrons par ADU. Le paramètre de gain défini par la norme EMVA1288 ne doit pas être confondu avec le gain du processus de conversion « analogique-numérique ».

Lors de l'évaluation des performances de la caméra, il est très courant de se référer au rapport signal sur bruit et à la plage dynamique. Ces deux mesures de la performance de la caméra prennent en compte le rapport du bruit observé par la caméra par rapport au signal. La différence réside dans le fait que la plage dynamique prend uniquement en compte le bruit d'obscurité temporel, tandis que le rapport signal/bruit inclut également la moyenne quadratique (RMS) du bruit de grenaille.

Le seuil de sensibilité absolue est le nombre de photons nécessaires pour obtenir un signal équivalent au bruit observé par le capteur. C'est une mesure importante car elle représente la quantité minimale théorique de lumière nécessaire pour observer un signal représentatif. Les détails de cette mesure seront traités plus en détail dans les articles suivants.

Pour aider à comparer les capteurs et les caméras selon la norme EMVA1288, FLIR a créé une étude complète unique en son genre sur la performance de l’imagerie de plus de 70 modèles de caméras.

| Mesure | Définition | Influencé par | Unité |

| Bruit de grenaille | Racine carrée du signal | Causée par la nature de la lumière | e- |

| Taille de pixel | Puits, taille de pixel | Conception du capteur | µm |

| Efficacité quantique | Pourcentage de photons convertis en électrons à une longueur d'onde particulière | Conception du capteur | % |

| Bruit d'obscurité temporel (Bruit de lecture) | Bruit dans le capteur lorsqu'il n'y a pas de signal. | Conception de la caméra et du capteur | e- |

| Capacité de saturation (Profondeur du puits) | Quantité de charge qu'un pixel peut contenir. | Conception de la caméra et du capteur | e- |

| Rapport signal sur bruit maximal | Rapport le plus élevé possible entre un signal et tout le bruit inclus dans ce signal, y compris le bruit de grenaille et le bruit d'obscurité temporel. | Conception de la caméra et du capteur | dB, bits |

| Plage dynamique | Rapport du signal sur bruit incluant uniquement le bruit d'obscurité temporel | Conception de la caméra et du capteur | dB, bits |

| Seuil de sensibilité absolue | Nombre de photons nécessaires pour obtenir un signal égal au bruit | Conception de la caméra et du capteur | Ƴ |

| Gain | Paramètre indiquant l'ampleur du changement d'électrons nécessaire pour observer un changement dans les ADU 16 bits (mieux connu sous le nom d'échelle de gris). | Conception de la caméra et du capteur | e-/ADU |

Comparer les performances à faible luminosité des caméras

Pour les besoins de ce livre blanc, nous analyserons des applications telles que la reconnaissance de plaques d'immatriculation (LPR) ou la reconnaissance optique de caractères (OCR) où l'imagerie monochrome est couramment utilisée et la quantité de lumière que la caméra peut capter peut être limitée en raison de temps d'exposition courts. Il est assez simple de déterminer la résolution, la fréquence d'images et le champ de vision requis pour résoudre un problème d'imagerie, mais il peut être plus difficile de déterminer si les performances d'imagerie d'une caméra seront suffisantes.

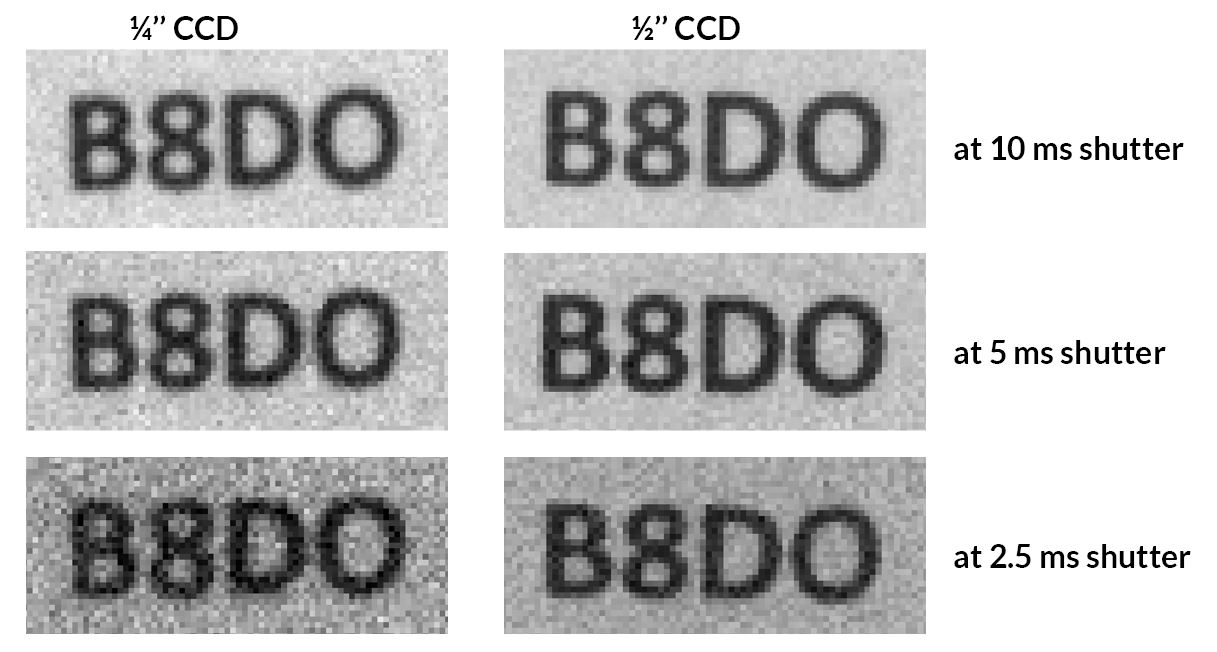

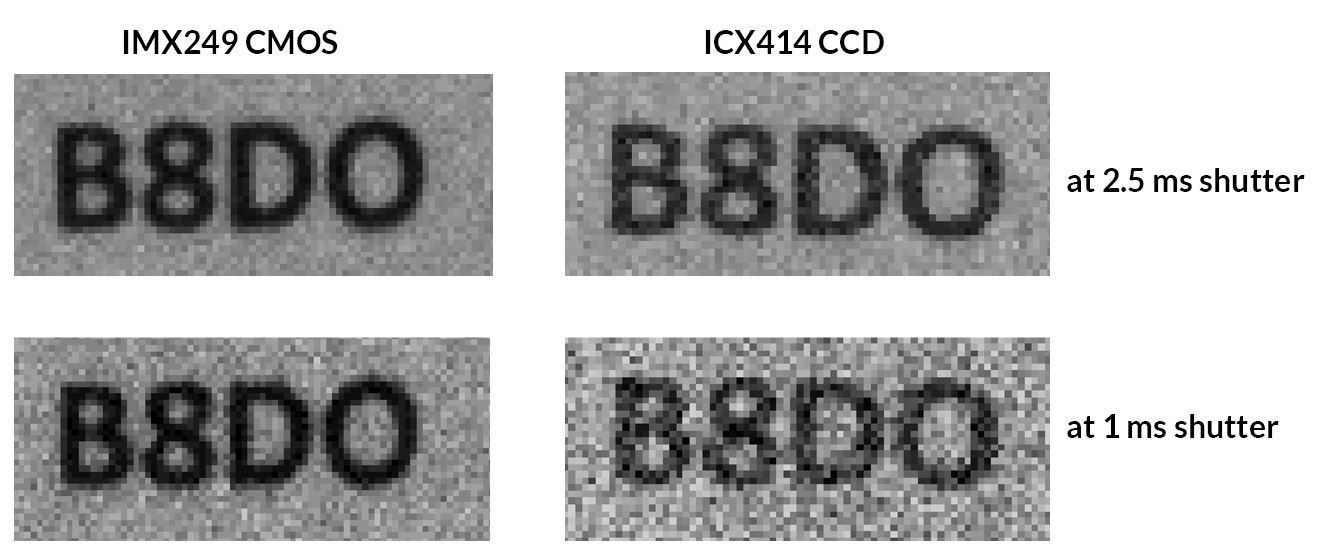

Ce défi est généralement résolu en réalisant plusieurs tentatives. Prenons un exemple où un concepteur de systèmes de vision détermine qu’une caméra VGA avec CCD ¼’’ fonctionnant à 30 FPS est suffisante dans l’application. Les tests initiaux peuvent montrer que la caméra a une sensibilité suffisante aux temps d'exposition de 10 ms lorsque l'objet est à l'arrêt. Voir la figure 2 montrant un exemple simple avec les caractères B, 8, D et 0 qui peuvent être facilement confondus par un algorithme de vision. L’image en haut à gauche prise avec une caméra CCD ¼’’ produit des images adaptées au traitement de l’image.

Figure 2 : Résultats obtenus à partir de caméras CCD 1/4'' et 1/2'' à différents temps d'exposition

Cependant, lorsque l'objet commence à se déplacer, les temps d'exposition doivent être réduits et la caméra ne peut pas fournir d'informations utiles car les lettres « B » et « D » sont difficiles à distinguer de « 8 » et « 0 ». Les images au milieu et en bas à gauche de la figure 2 montrent une détérioration de la qualité de l'image. En particulier, un CCD de ¼’’ à un temps d’exposition de 2,5 ms produit des images inadaptées au traitement de l’image.

Aux fins de cet exemple, l’hypothèse est qu’une grande profondeur de champ n’est pas nécessaire et que le nombre F minimum de la lentille est donc acceptable. En d'autres termes, il n'est pas possible de collecter plus de lumière en ouvrant l'obturateur de la lentille.

Le concepteur doit donc envisager d'utiliser une autre caméra. La question est de savoir si une caméra différente peut améliorer les performances du système. L’utilisation d’un capteur de plus grande taille est généralement considérée comme un bon moyen de résoudre les problèmes de performance dus à la faible luminosité. Un capteur de ½’’ pourrait donc être un bon choix. Mais au lieu de poursuivre les différentes tentatives, il peut être utile de considérer les performances d'imagerie EMVA 1288 de la caméra.

| Caméra | Capteur | Taille de pixel (μm) | Efficacité quantique (%) | Bruit d'obscurité temporel (e-) | Capacité de saturation(e-) |

| Caméra 1/4’’ (FL3-GE-03S1M-C) | ICX618 | 5,6 | 70 | 11,73 | 14 508 |

| Caméra 1/2’’ (BFLY-PGE-03S3M-C) | ICX414 | 9,9 | 39 | 19,43 | 25 949 |

En examinant les données EMVA 1288, on peut observer que le capteur ¼’’ a un meilleur rendement quantique et un bruit plus faible, mais que le CCD ½’’ a un pixel plus grand et une capacité de saturation plus importante. Cet article montre comment déterminer si la caméra ½’’ fonctionnera mieux.

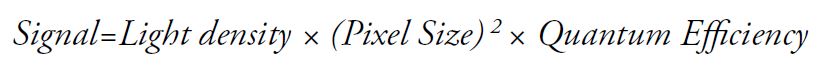

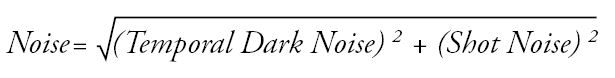

La figure 3 compare les caméras en traçant la valeur du signal en fonction de la densité de la lumière (photons/µm2). Le signal en fonction de la densité lumineuse est déterminé à l'aide de la formule suivante :

Une hypothèse importante de cet article est que les lentilles ont le même champ de vision, le même nombre F et les mêmes réglages de caméra.

Figure 3 : Signal produit par les caméras CCD 1/4’’ et 1/2’’ en fonction du niveau de lumière

Abonnez-vous pour voir d’autres articles similaires

La figure montre que pour une même densité de lumière, le capteur ½’’ génère un signal plus élevé. On peut également observer que la saturation se produit à un niveau de densité de lumière similaire de 700 photons/µm2. Cependant, le capteur de ½’’ a une capacité de saturation nettement plus élevée.

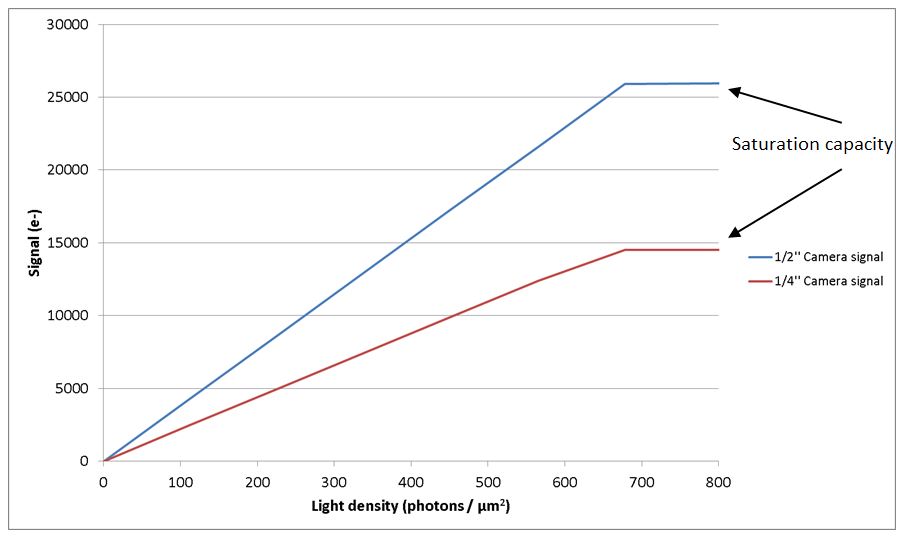

Dans l'application considérée dans ce livre blanc, la comparaison des caméras doit être effectuée à un niveau de lumière faible. Par conséquent, tenir compte des niveaux de bruit devient particulièrement important.

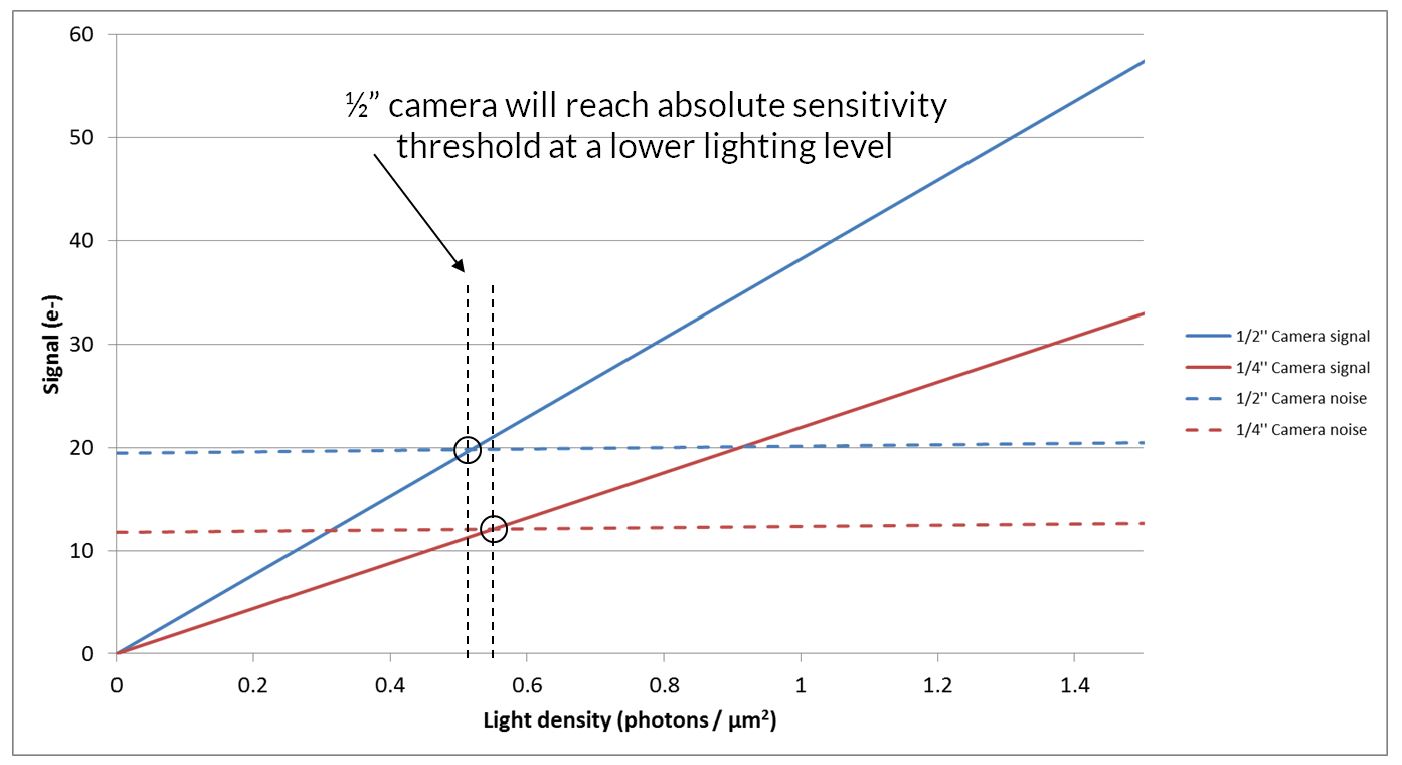

La figure 4 montre le signal et le bruit à des niveaux d'éclairage faibles. Le bruit présenté dans la figure est une addition de la moyenne quadratique du bruit d'obscurité temporel et du bruit de grenaille qui a été calculée à l'aide de la formule suivante :

Figure 4 : Signal et bruit des caméras CCD 1/4’’ et 1/2’’ à des niveaux de lumière faibles

Le graphique montre que le seuil de sensibilité absolue (le niveau de lumière auquel le signal est égal au bruit) est atteint par le capteur ½’’ à un niveau légèrement inférieur à celui du capteur ¼’’. La mesure la plus importante nécessaire pour déterminer quelle caméra sera la plus performante dans les applications à faible luminosité est le rapport signal sur bruit (SNR).

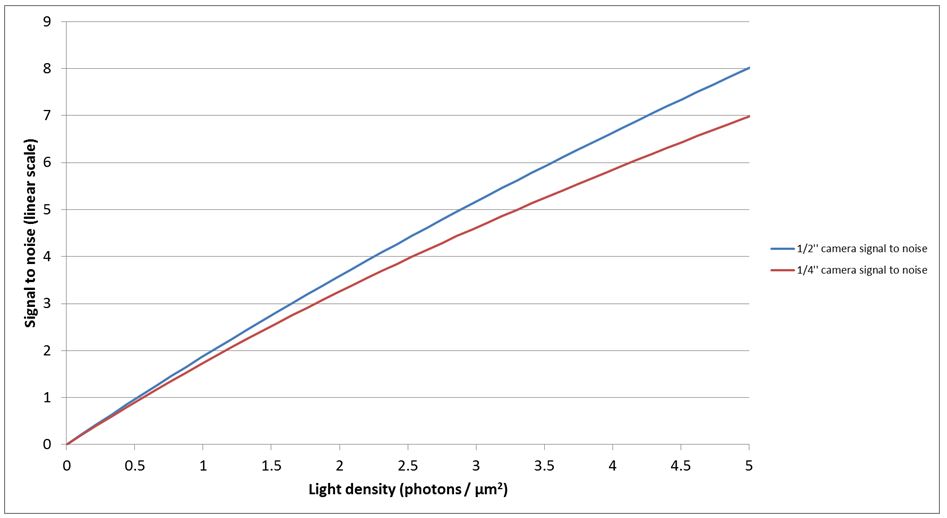

La figure 5 montre le SNR des deux caméras en fonction du niveau d'éclairage.

Figure 5 : Rapport signal/bruit des caméras CCD 1/4’’ et 1/2’’ à des niveaux de lumière faibles

En fonction du rapport plus élevé du signal/bruit du capteur ½’’, il est théoriquement suggéré que la caméra ½’’ fonctionne mieux que la caméra ¼’’ à faible luminosité.

À partir des images de la figure 2, on peut voir qu’à un temps d'exposition de 2,5 ms, le capteur ½’’ préserve la forme des caractères à tout moment, tandis que le capteur ¼’’ rend difficile la distinction entre les caractères. Le capteur ½’’ fonctionne donc mieux et les résultats pratiques sont en accord avec la théorie.

FLIR a effectué une étude approfondie des caméras et a publié les résultats de performance d'imagerie EMVA 1288. Ces informations peuvent être utilisées pour comparer les performances de différents modèles de caméra. Bien que la mise en œuvre de la caméra ait une influence sur les performances de l’imagerie, cette étude peut être généralement utile pour comparer deux caméras avec des capteurs traités dans le document.

FLIR propose des documents de comparaison de caméras spécifiques. Veuillez contacter mv-info@flir.com pour demander une comparaison entre les modèles de caméras FLIR.

Il convient de noter que la méthode décrite dans ce livre blanc est utile pour avoir une idée générale de la performance d’une caméra par rapport à une autre. Cette méthode peut aider à exclure les caméras qui ne sont pas susceptibles d'améliorer les performances requises. Cependant, le test ultime des performances de la caméra se situe dans l'application réelle.

Comparaison d'un CCD traditionnel avec un capteur CMOS moderne

Nous allons maintenant comparer les performances d'un capteur CCD traditionnel avec celle d'un capteur CMOS moderne dans des conditions d'imagerie par faible luminosité et dans une scène présentant un large éventail de conditions d'éclairage.

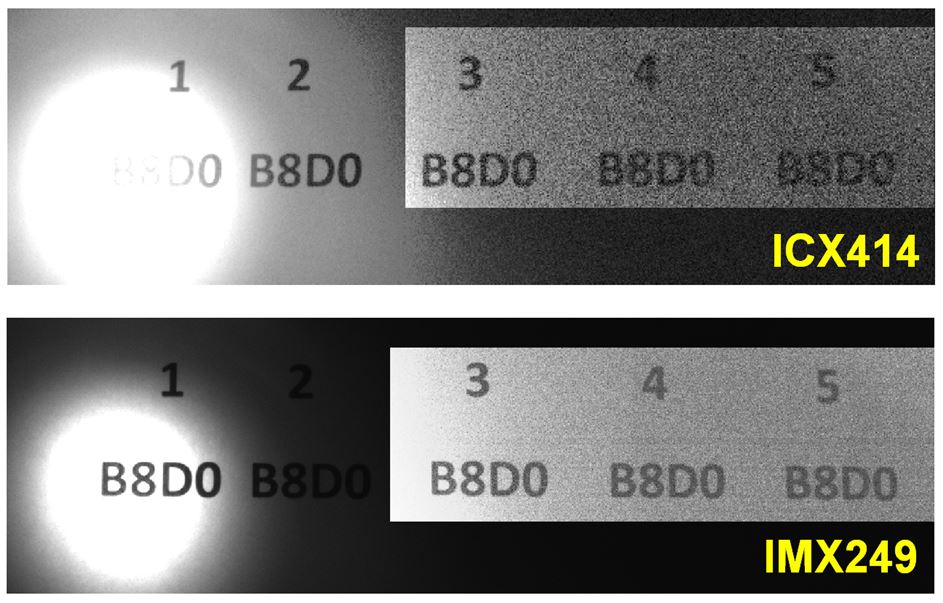

Dans la section précédente, nous avons montré qu’une caméra avec le Sony ICX414, un CCD ½’’ VGA, fonctionne mieux dans des conditions de faible luminosité qu’une caméra avec le Sony ICX618, un CCD VGA ¼’’. Nous allons maintenant comparer le CCD ½’’ VGA avec le nouveau capteur CMOS à obturateur global Pregius de Sony IMX249, 1/1,2’’ 2,3Mpix

À première vue, on peut sembler comparer des « pommes et des poires », mais le coût des caméras avec ces deux capteurs est comparable à environ 400 € près, une région VGA présentant un intérêt pour la caméra CMOS est en réalité plus proche de la taille optique de la caméra ¼’’ et les fréquences d'image sont également similaires à la résolution VGA.

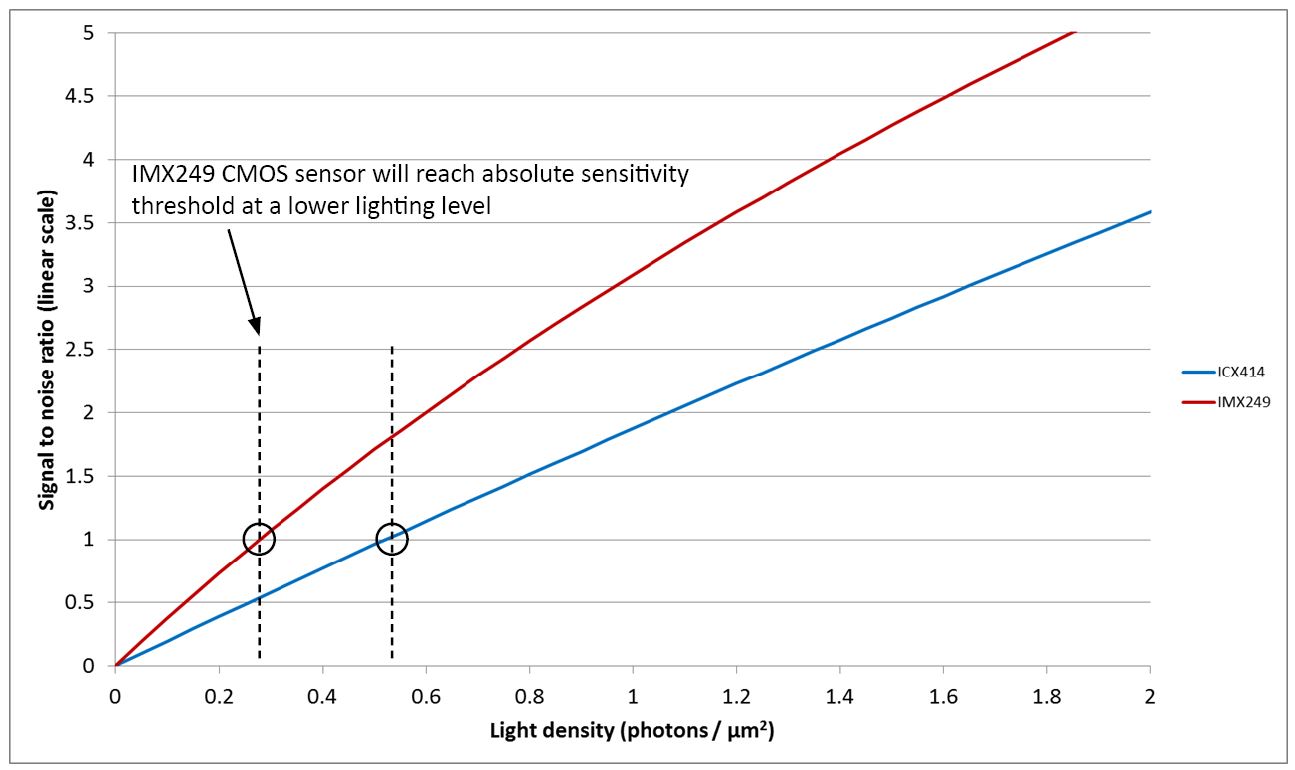

Les données EMVA 1288 pour les caméras montrent que le capteur CMOS IMX249 présente un meilleur rendement quantique, un bruit plus faible et une capacité de saturation plus élevée. D'autre part, le capteur CCD ICX414 a un pixel plus grand, qui était le paramètre critique dans l'exemple présenté dans l'article précédent.

| Caméra | Capteur | Taille de pixel (μm) | Efficacité quantique (%) | Bruit d'obscurité temporel (e-) | Capacité de saturation (e-) |

| Caméra 1/2’’ (BFLY-PGE-03S3M-C) | ICX414 | 9,9 | 39 | 19,43 | 25 949 |

| Caméra 1/1,2’’ CMOS (BFLY-PGE-23S6M-C) | IMX249 | 5,86 | 80 | 7,11 | 33,105 |

Figure 6 : Rapport signal/bruit des capteurs CCD ICX414 et CMOS IMX249 à faibles niveaux de lumière

Figure 7 : Résultats obtenus avec les capteurs CCD ICX414 et CMOS IMX249 à différents temps d'exposition

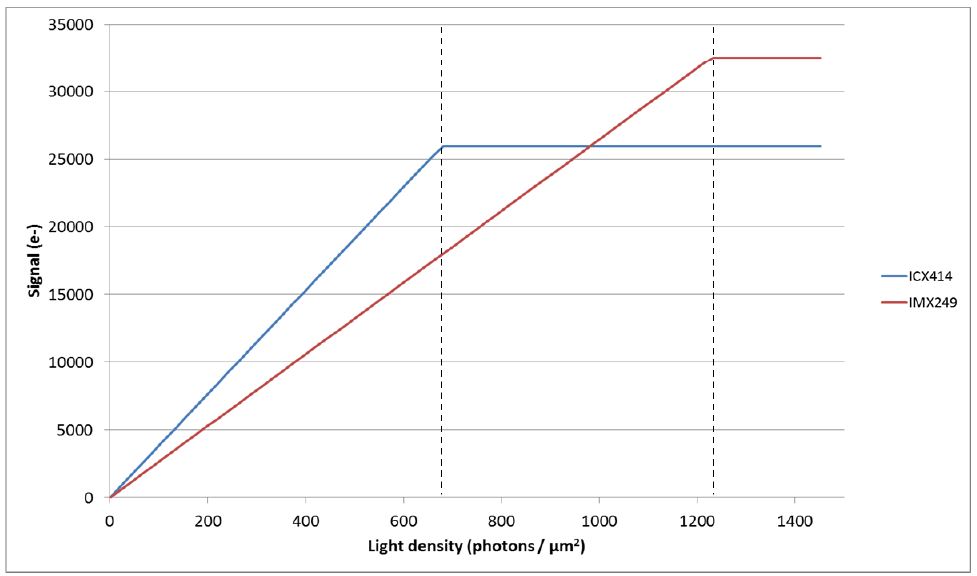

La comparaison la plus intéressante est à des intensités lumineuses plus élevées en raison de la différence de capacité de saturation des deux capteurs. La figure 8 montre le signal en fonction de l'intensité lumineuse sur toute la gamme des intensités lumineuses. À partir du graphique, on peut observer que le capteur CCD ICX414 atteindra une capacité de saturation à environ 700 photons/µm2, tandis que le capteur CMOS IMX249 sature à plus de 1 200 photons/µm2.

Figure 8 : Signal produit par le capteur CCD ICX414 et CMOS IMX249 en fonction du niveau de lumière

La première conclusion qui peut être faite est que l'image produite par le capteur CCD ICX414 sera plus lumineuse que l'image produite par le capteur CMOS IMX249. Si cela n’est pas évident sur le graphique, considérez l’image qui serait produite à environ 700 photons/µm2. Dans le cas du capteur CCD ICX414, l'image devrait être au plus haut niveau de gris, probablement saturé, tandis que le capteur IMX249 CMOS produirait une image d'un peu plus de 50 % de la luminosité maximale. Cette observation est significative car une approche naïve pour évaluer la sensibilité de la caméra consiste à observer la luminosité de l'image. En d'autres termes, l'hypothèse est qu'une image plus lumineuse proviendra d'une caméra avec de meilleures performances. Ce n'est cependant pas vrai et dans cet exemple, c'est le contraire, la caméra qui produit des images plus sombres en fait de meilleures performances.

Figure 9 : Résultats obtenus avec les capteurs CCD ICX414 et CMOS IMX249 dans des conditions d'éclairage difficiles

La seconde observation est que le capteur CMOS IMX249 produira des images utiles pour le traitement d'images dans une large gamme de conditions d'éclairage. La figure 9 montre la même scène reproduite par les deux caméras. Il convient de noter que la partie la plus sombre des images a été améliorée à des fins d'affichage, mais les données sous-jacentes n'ont pas été modifiées. À partir des images, on peut observer que le CCD ICX414 est saturé dans les zones claires de la scène, alors qu’il y a trop de bruit dans les zones sombres pour que les caractères soient lisibles. Au contraire, le capteur CMOS IMX249 produit des caractères lisibles dans les parties claires et sombres de la scène.

Enfin, nous pouvons conclure que la récente technologie CMOS à obturateur global est devenue une alternative viable aux CCD dans les applications de vision artificielle. Les capteurs sont non seulement moins coûteux, ont des fréquences d'images supérieures à des résolutions équivalentes et ne présentent pas d'artefacts tels que des bavures et des efflorescences, mais ils dépassent également les performances d'imagerie des capteurs CCD.

Comparaison des générations de capteurs Sony Pregius

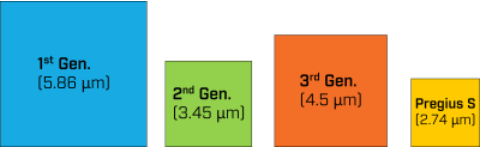

Comme nous l'avons vu dans la section précédente, la taille du capteur a un impact important sur ses performances, car des pixels plus grands permettent de collecter un nombre de photons maximum plus élevé, ainsi qu'un plus grand nombre de photons dans les mêmes conditions d'éclairage. La contrepartie d'une taille de pixel plus grande est que la taille du capteur devra également être plus grande pour obtenir une résolution donnée par rapport à l'utilisation d'un capteur présentant une taille de pixel plus petite, ce qui augmente le coût du capteur. La figure ci-dessous illustre l'évolution de la taille des pixels entre les différentes générations de capteurs Sony Pregius.

Figure 10 : Différences de taille des pixels entre les différentes générations de capteurs Sony Pregius

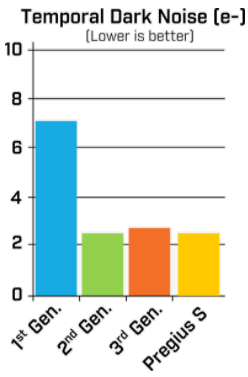

Malgré la tendance à une diminution de la taille des pixels (à part la 3e génération du capteur), les performances d'imagerie du capteur ont augmenté avec chaque génération, à l'exception de la capacité du capteur. L'amélioration des performances d'imagerie est principalement due au faible bruit d'obscurité temporel du capteur, que l'on retrouve à partir de la deuxième génération. La figure ci-dessous montre l'évolution du bruit d'obscurité temporel du capteur au cours des différentes générations de capteurs Pregius.

Figure 11 : Le capteur Pregius S maintient un faible niveau de bruit de lecture

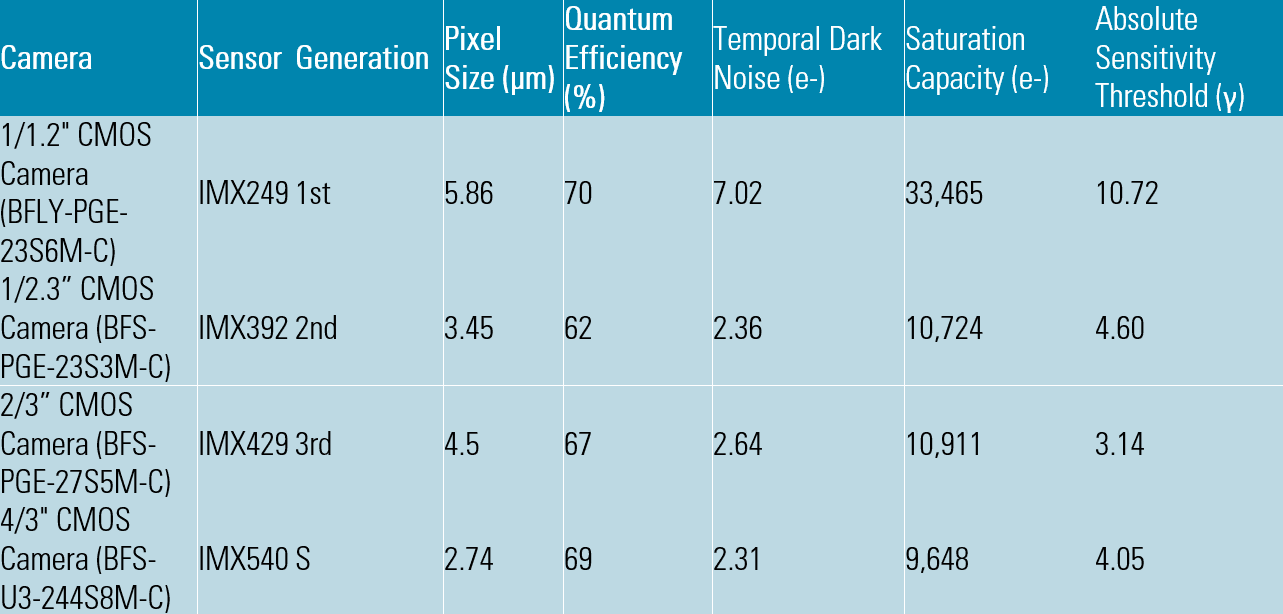

Pour avoir une vue complète des performances d'imagerie du capteur, veuillez vous référer au tableau ci-dessous pour les spécifications d'un capteur représentatif de chaque génération de Pregius.

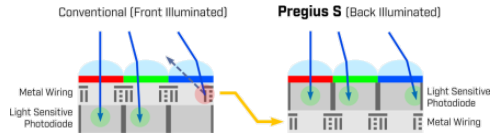

En observant le tableau ci-dessus, on peut remarquer que malgré la plus petite taille de pixel, les performances d'imagerie du capteur Pregius S sont comparables à celles des capteurs de 2e et 3e génération, en raison de la conception rétroéclairée du capteur qui permet un angle d'entrée plus large pour le photon, ce qui aide à capturer plus de lumière sur le pixel.

Figure 12 : Les capteurs BSI inversent la conception du capteur à illumination classique par la face avant de manière à faciliter l’entrée des photons dans la photodiode sensible à la lumière de chaque pixel

Cette nouvelle conception de capteur permet à la famille de capteurs Pregius S de maintenir les performances d'imagerie des générations précédentes tout en utilisant les plus petits pixels, ce qui permet d'obtenir des capteurs de plus haute résolution à des prix relativement bas.

Conclusion

Dans ce livre blanc, nous avons appris les concepts clés utilisés pour évaluer les performances des caméras. Nous avons présenté la norme EMVA1288 et appliqué les résultats pour comparer les performances de l'appareil photo dans diverses conditions d'éclairage. Il y a encore beaucoup d'autres aspects de la performance de la caméra qui peuvent être pris en compte lors de l'évaluation des caméras. Par exemple, l'efficacité quantique change radicalement à différentes longueurs d'onde, de sorte qu'une caméra qui fonctionne bien à 525 nm peut ne pas être aussi performante lorsque la source de lumière est à des fréquences proche infrarouges (NIR). De même, les temps d'exposition longs communs à la fluorescence et à l'imagerie astronomique doivent prendre en compte les effets du courant d'obscurité, un type de bruit important à des niveaux de lumière extrêmement faibles.

La sélection de la bonne caméra en fonction des caractéristiques de performance de l’imagerie n’est pas facile, mais nous espérons que ce livre blanc aura aidé à comprendre ce sujet fascinant et complexe.

Filtrez et triez grâce à plus de 14 spécifications EMVA pour trouver la correspondance exacte aux exigences de votre projet - Essayez notre nouveau sélecteur de caméra.